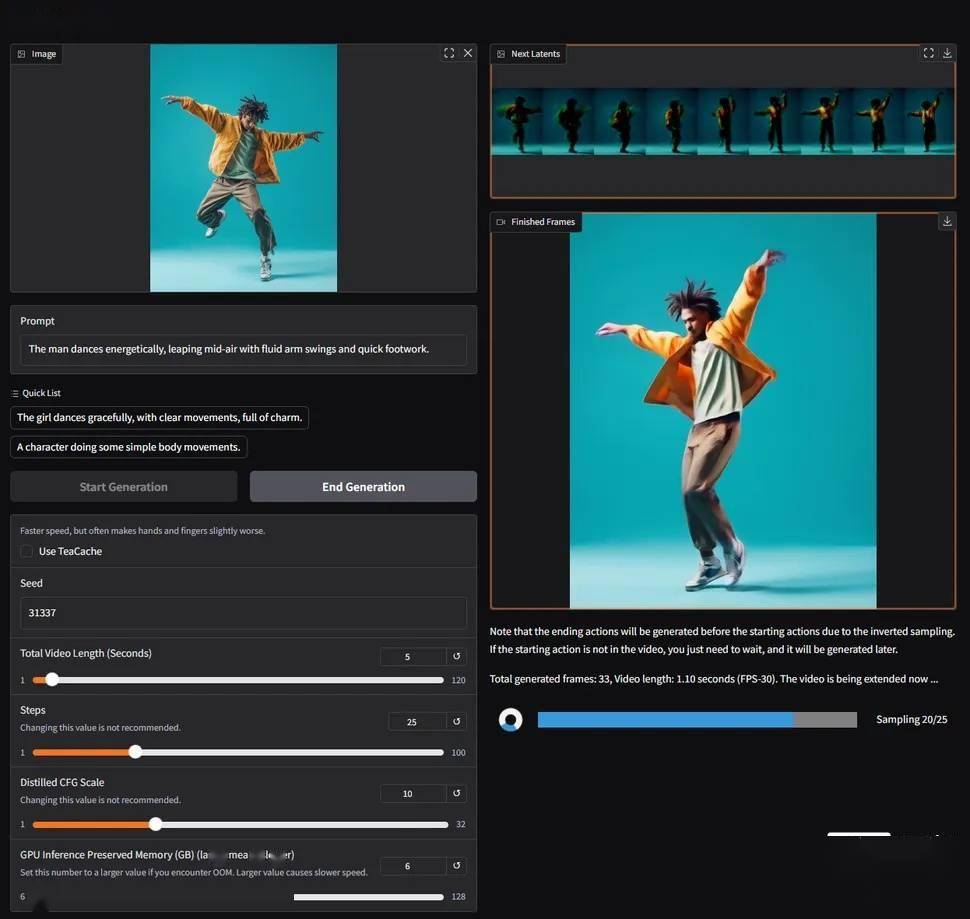

近日,一项名为framePack的创新技术横空出世,为AI视频生成领域带来了革命性的突破。这项技术由GitHub的Lvmin Zhang与斯坦福大学的Maneesh Agrawala携手打造,成功实现了视频扩散模型的实用化,极大地提升了处理效率,使得在较低硬件配置下生成高质量长视频成为可能。

framePack是一种全新的神经网络架构,其核心优势在于采用了多阶段优化技术,有效降低了AI视频生成任务对硬件的需求。通过利用固定长度的时域上下文,framePack能够显著减少GPU的显存开销,使得在仅6GB显存的情况下,也能生成长达60秒的视频片段。这一突破性的成果得益于framePack独特的帧压缩技术,它能够对帧进行智能压缩,并汇集到固定大小的上下文长度内,从而确保了高效的显存利用。

传统的视频扩散模型在生成视频时,需要处理大量的先前生成的带噪帧数据,以预测下一个噪声更少的帧。这一过程中,所参考的输入帧数量会随着视频长度的增加而增长,导致显存需求极高。而framePack则通过其创新的架构,成功解决了这一问题。它不仅能够降低显存消耗,还能在不显著牺牲保真度的情况下,支持生成更长的视频内容。

framePack还结合了缓解“漂移”现象的技术。这一技术能够解决视频质量随长度增加而下降的问题,确保生成的视频内容始终保持高质量。在硬件兼容性方面,framePack明确要求使用支持FP16和BF16数据格式的英伟达RTX 30、40或50系列GPU。对于其他品牌的硬件以及更早的英伟达显卡,目前尚未得到验证。但考虑到6GB显存的需求,市面上大多数现代RTX显卡都能满足运行要求。

在性能方面,framePack同样表现出色。以RTX 4090为例,在启用teacache优化后,生成速度可达每秒约0.6帧。虽然实际速度会因显卡型号的不同而有所差异,但framePack在生成过程中会逐帧显示画面,提供即时的视觉反馈,这一特性极大地提升了用户体验。

值得注意的是,framePack所使用的模型目前可能有30帧/秒的上限,这或许会限制部分用户的需求。然而,对于大多数普通消费者而言,framePack的出现无疑为他们进行AI视频创作提供了极大的便利。它不仅为专业内容创作者提供了一种替代昂贵第三方云服务的可行方案,还为非专业用户制作GIF动图、表情包等娱乐内容提供了有趣的工具。

随着framePack技术的不断发展和完善,相信未来会有更多的用户能够享受到AI视频生成带来的乐趣和便利。这一技术的出现,无疑为AI视频生成领域注入了新的活力和希望。